Ich fasse mal zwei Themen rund um das Thema KI in einem Sammelbeitrag zusammen. Es gibt inzwischen eine KI-Verordnung der EU, die von Unternehmen umgesetzt werden muss. Bitkom hat einen Leitfaden zur Umsetzung veröffentlicht. Und der LfD Niedersachsen und andere Aufsichtsbehörden haben sich mit ChatGPT beschäftigt. Zeit für einen Blick auf diese Sachverhalte.

Ich fasse mal zwei Themen rund um das Thema KI in einem Sammelbeitrag zusammen. Es gibt inzwischen eine KI-Verordnung der EU, die von Unternehmen umgesetzt werden muss. Bitkom hat einen Leitfaden zur Umsetzung veröffentlicht. Und der LfD Niedersachsen und andere Aufsichtsbehörden haben sich mit ChatGPT beschäftigt. Zeit für einen Blick auf diese Sachverhalte.

ChatGPT und der Datenschutz

Ich bin bereits vor einigen Tagen darauf gestoßen, dass der LfD Niedersachsen und andere Aufsichtsbehörden sich mit ChatGPT beschäftigt haben. Der Landesbeauftragte für den Datenschutz (LfD) Niedersachsen geht in seinem Tätigkeitsbericht für das Jahr 2023 zusammen mit anderen Aufsichtsbehörden auf ChatGPT ein und hat eine datenschutzrechtliche Bewertung des Chatbots vorgenommen (vgl. LfD Niedersachsen, Tätigkeitsbericht 2023, S. 52 ff.).

Die Kollegen von Datenschutz-Notizen.de haben das Ganze in diesem Artikel aufbereitet. Das kurze Fazit: Die Datenschutzaufsicht sieht ChatGPT im Hinblick auf die DSGVO als problematisch an und es lauern Hürden, über die Firmen beim allzu schnellen Einsatz stolpern könnten.

Die Kollegen von Golem hatten zudem kürzlich den Artikel Studie stellt Vertrauenswürdigkeit von ChatGPT infrage zu einem anderen heiklen Thema veröffentlicht.

EU-AI-Verordnung umsetzen

Es gibt inzwischen eine KI-Verordnung der EU, die von Unternehmen umgesetzt werden muss. Aber noch hat kaum jemand einen Plan, was dort zu tun und zu lassen ist.

Prof. Dennis Kipker weist in obigem Tweet darauf hin, dass die Bitkom einen Umsetzungsleitfaden zur KI-Verordnung veröffentlicht hat. Der Umsetzungsleitfaden soll Unternehmen, die KI-Systeme in Verkehr bringen oder betreiben, dabei unterstützen, die rechtlichen Vorgaben der Verordnung (EU) 2024/1689 vom 13. Juni 2024 zur Festlegung harmonisierter Vorschriften für künstliche Intelligenz (KI-VO) erfolgreich und im Sinne des Gesetzgebers zu implementieren.

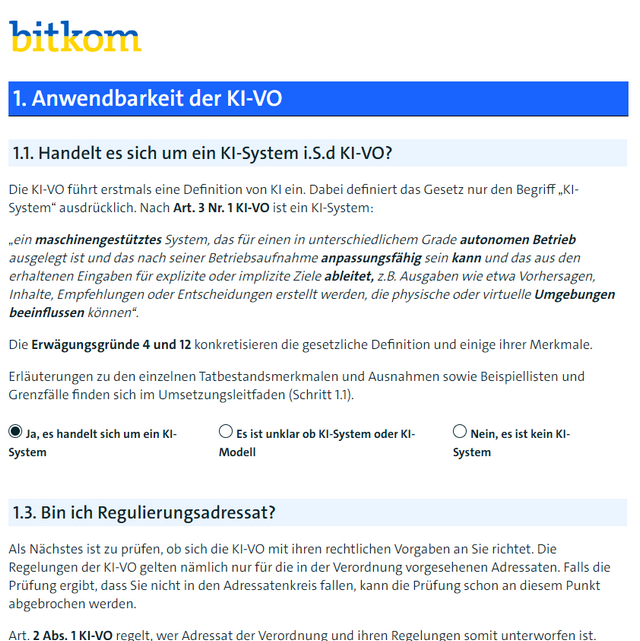

Der Bitkom-Leitfaden zur Umsetzung steht als PDF-Dokument zum Download zur Verfügung. Auf der Bitkom-Umsetzungsseite ist aber auch ein „Click-Through-Tool“ implementiert, wo man Fragen durchgehen und über Optionsfelder eine Auswahl treffen kann.

Ich habe mal kurz drüber geschaut – das „Click-Through-Tool“ ermöglicht einem schnell bestimmte Entscheidungsbäume zu durchlaufen. In jedem Schritt gibt es Erläuterungen, was durch die KI-VO und die DSGVO rechtlich zu beachten ist. Vielleicht hilft es bei der Prüfung, was auf ein Unternehmen zukommt, etwas weiter.

sehr interessant..

das werde ich bei uns im DVA des GBR’s mal anbringen…

Haben gerade wieder interne Verfahren mit eigener KI die der AG einsetzen will.

Haben schon genug Ärger, GBV’n zu MS Produkten hinzubekommen.

Ein klassischer Auftragnehmer im Sinne der DSGVO is MS ja nich, denn die machen ja was sie wollen…Und unser Auftraggeber, die IT der GBU Deutschland ist komplett fremdgesteuert von der IT in Franzland, obwohl sie im Sinner der DSGVO weisungsbefugt sein müsste.

meist halt nur in einer ständigen Einigungsstelle (semi-)erfolgreich ;-)

Was heißt den „anpassungsfähig sein kann“? Da steht KANN und nicht muss MUSS. Hier wird es dann etwas komisch, da auch 0815 Kundendialogsysteme KI sein können. Wenn ich einen Preisvergleichswebseite habe, wo als Ergebnis „Sie sollten den Vertrag wechseln“ rauskommt, dann wäre das nach der Definition KI. Auch wenn nur zwei Zahleb verglichen werden. Ist nachvollziehbar, aber würde die lächerliche Meldung fehlen, wäre es keine KI?

Eigentlicht macht doch genau der Punkt mit der anpassungsfähigkeit KI besonders Datenschutzkritisch, weil dadurch KI nach der Betriebsaufgabe die Eingaben weiter nutzt.

Es gibt ja zwei Fälle. Entweder sind die Daten schon vor dem Training drinnen oder es kommen nach dem Training (noch) Daten hinzu. Wenn ich eine „KI“ habe, die ich mit wirklich anonymen oder ausgedachten Fallbeispielen füttert und keine Eingaben verarbeitet? Die ist strengenommen Datenschutzunkritisch, es können keine Daten hinzu kommen. Zumindest werden die Eingaben wie bei jedem Formular nur bissel durch den Alorithmuss geschickt.

Ich bin auch über diese Definition gestolpert.

Demnach müsste z.B. eine Heizungssteuerung, die etwa den Sonnenstand oder die Wettervorhersage einbezieht, als KI-System gelten? Oder ein Navigationssytem, das die Verkehrslage mit berücksichtigt?

… oder ein Textfeld mit Autocomplete?

Kommt es noch jemand so vor als würde das Bitkom-Tool den AI-Ansatz der 80-er (Expertensystem) verwenden, um potenzielle AI-Systeme der 20-er zu klassifizieren?

Letztendlich sind sie ja auch nur eine evolutionäre Weiterentwicklung der ELIZA, Systeme, die mit im Prinzip vorgegebenen Algorithmen auf den ersten Blick verblüffende Resultate erzielen können.

Die große Gefahr liegt in der schieren Menge der zum Training verwendeten Datenbasis, in der sich eben auch Informationen verstecken, die man nicht ausgeplaudert haben möchte.

Bei dem Bitkom Leitfaden heißt es :

„Der vorliegende Umsetzungsleitfaden soll Unternehmen, die KI-Systeme in Verkehr bringen oder betreiben, dabei unterstützen …“

Kann mir jemand sagen, was mit „in Verkehr bringen oder betreiben“ gemeint ist?

Sind hier nur Firmen angesprochen, die ein eigenes/neues KI-System generieren oder sind auch Firmen angesprochen, die z.B. ChatGPT für ihre Mitarbeiter frei geben?

Vermutlich „auf Kunden loslassen“, wie die allseits wie Pilze auf den Websiten wachsenden Chatbots, denen die Kunden ihr Problem anvertrauen sollen.

Ist der Leitfaden also auch an Firmen gerichtet, die für interne Zwecke irgendeine öffentliche KI (z.B. ChatGPT) nutzen wollen?

Imho ja.