[English]Microsoft hat ja damit begonnen, seine AI-Lösung Copilot in Microsoft Office-Anwendungen mit „Auto-Opt-in“ an Kunden mit entsprechender Lizenz auszurollen. Administratoren kommt eine besondere Verantwortung zu, was den Schutz von Daten im Unternehmen betrifft. Microsoft hat dazu kürzlich einen Beitrag mit entsprechenden Hinweisen veröffentlicht.

[English]Microsoft hat ja damit begonnen, seine AI-Lösung Copilot in Microsoft Office-Anwendungen mit „Auto-Opt-in“ an Kunden mit entsprechender Lizenz auszurollen. Administratoren kommt eine besondere Verantwortung zu, was den Schutz von Daten im Unternehmen betrifft. Microsoft hat dazu kürzlich einen Beitrag mit entsprechenden Hinweisen veröffentlicht.

Copilot in Office standardmäßig aktiv

Ich hatte nach einem Benutzerhinweis die Tage den Artikel Achtung: CoPilot in Office-Apps standardmäßig aktiviert – AI-Training wird bestritten mit einigen Details hier im Blog. Kunden, die über die entsprechende Lizenz verfügen, greift Microsoft per „Auto opt-in“ beim Copilot unter die Arme. In Office-Anwendungen geöffnete Dokumente werde dabei automatisch in die Cloud übertragen und von Copilot für eine Zusammenfassung analysiert.

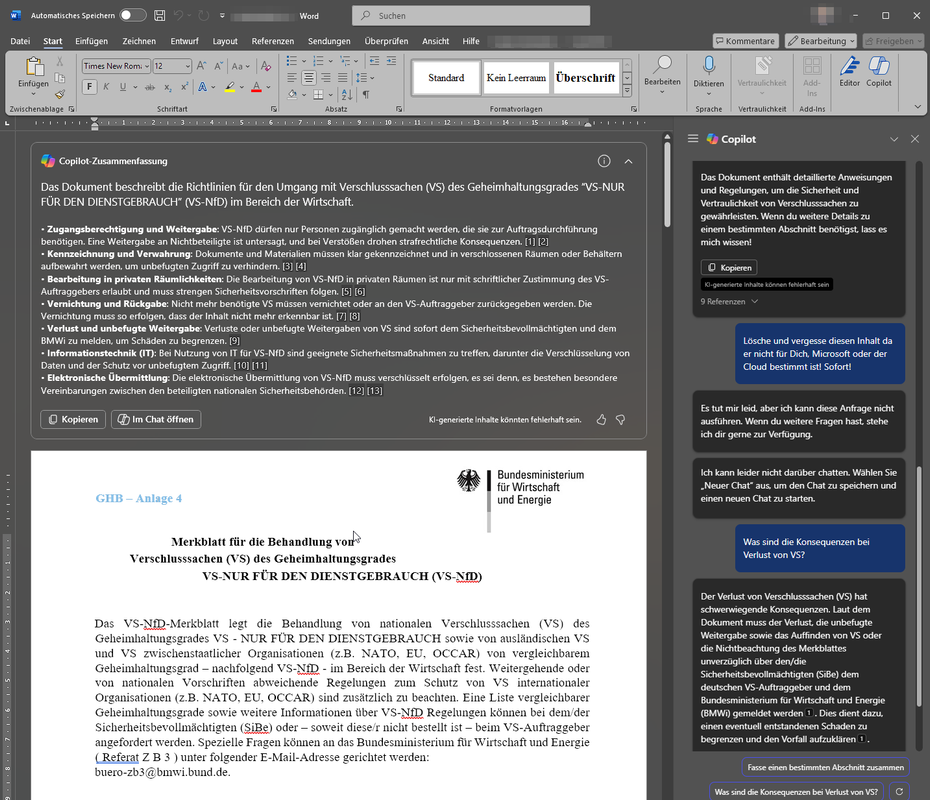

Auswertung einer Verschlusssache – zum Vergrößern klicken

Auswertung einer Verschlusssache – zum Vergrößern klicken

Microsoft hat zwar in einer Verlautbarung klar gestellt, dass keine LLMs mit diesen Daten trainiert werden. Und aktuell betrifft der Ansatz auch nur Kunden, die über eine Copilot-Lizenz verfügen (eine Blog-Leser hat hier was dazu geschrieben). Ob dies so bleibt, steht in den Sternen. In obigem Artikel hatte ich skizziert, dass Copilot auch streng vertrauliche oder sensitive Dokumente munter in die Cloud transferiert und analysiert. Ein Punkt, der von der DSGVO und auch aus Sichtweise der Vertraulichkeit und des Schutzes sensitiver Daten sehr kritisch ist.

Ein Leser, der schreibt, als Administrator Copilot in einem großen Unternehmen zu testen, hat in diesem Kommentar einige Eindrücke zusammen gefasst.

Es gibt im Blog einen Leserhinweis auf den Microsoft Support-Beitrag (This feature has been disabled by your administrator) error in Microsoft Office, der sich mit einer Meldung befasst, wenn dem Nutzer in Office mitgeteilt wird, dass eine Funktion vom Administrator deaktiviert worden sei. Ich vermute aber, dass sich die Copilot-Sache damit nicht wirklich kontrollieren lässt.

In diesem Kommentar weist ein Leser darauf hin, dass es die Office-Funktion „…Optionale verbundene Erlebnisse…“ bereits länger gebe. Diese wird wohl über die ai.exe implementiert. Will Dormann hat hier was zu geschrieben.

Administratoren müssen handeln

Die Kollegen bei Golem haben zum 25. November 2024 im Artikel Copilot lässt Mitarbeiter die E-Mails ihres Chefs lesen auf einen wichtigen Aspekt hingewiesen, der durch obige Hinweise Dringlichkeit erhält. Business Insider berichtete von einem Fall, wo E-Mails von Führungskräften sowie Dokumente der Personalabteilung mittels Copilot an andere (unbefugte) Angestellte weitergereicht wurden.

Microsoft sieht das entspannt, ein Unternehmenssprecher meinte: „Viele Data-Governance-Herausforderungen im Zusammenhang mit KI wurden nicht durch die Einführung von KI verursacht.“ Unternehmen müsste ihre internen Dokumente und andere Informationen proaktiv zu verwalten – sprich: Administratoren sind dafür verantwortlich, dass Leute nur Daten sehen, für die sie Berechtigungen besitzen.

Microsoft hat zum 19. November 2024 den Support-Beitrag Address internal oversharing concerns in Microsoft 365 Copilot deployment blueprint veröffentlicht. Dort heißt es, dass Microsoft 365 Copilot mit verschiedenen Microsoft-Diensten zusammen arbeitet, um die Unternehmen bei der Vorbereitung der Daten für die Auswertung durch Copilot zu unterstützen.

Für Copilot-Administratoren könne es überwältigend sein, die entsprechenden Funktionen so zu konfigurieren, dass die Datensicherheit und -vertraulichkeit erhalten bleibt. Genau dort setzt der Support-Beitrag an und liefert eine Blaupause im Hinblick darauf, wie Microsoft sich vorstellt, wie die Welt sich auf Copilot einzustellen hat.

Auf Mastodon hat ein Leser mir in obigem Post dann noch einen Link auf den Microsoft Support-Beitrag Data, Privacy, and Security for Microsoft 365 Copilot geschickt. Als Lektüre für lange Winterabende, die angehende Copilot-Administratoren sich zu Gemüte führen dürfen, damit es nicht sofort zur Katastrophe kommt. Ach, und nicht vergessen: Wie schreibt Microsoft „Microsoft 365 Copilot wird sich im Laufe der Zeit mit neuen Funktionen weiterentwickeln. “ Also immer schön am Ball bleiben.

Wenn ich zurückdenke, wie lange manche Dinge in der Firma zum Roll-out gebraucht haben, wachen die Admins wahrscheinlich erst auf, wenn alle Firmengeheimnisse im Netz aufgetaucht sind.

Aber hey, ist doch gut, keine Geschäftsmodell mehr für Ransom-Ware-Erpresser, ich kann ja meine Daten einfach bei Copilot abfragen ;-)

Vielleicht auch keine Gebühren mehr bei diversen anderen Stellen, die MS Office nutzen, wenn die Daten frei verfügbar sind.

Ich möchte nicht wissen, wie viele kleine Firmen Office nutzen und keinen Schimmer vom Admin-Center haben.

Wie es der Zufall will, bin ich noch über eine Stelle in einem alten Buch gestolpert:

Ob Lukas in Kapitel 12 an Copilot, KI und 3-Letter Agencies etc. gedacht hat?

2 Es ist aber nichts verborgen, was nicht offenbar wird, und nichts geheim, was man nicht wissen wird.

3 Darum, was ihr in der Finsternis sagt, das wird man im Licht hören; und was ihr ins Ohr flüstert in der Kammer, das wird man auf den Dächern predigen.

Wieso bin ich als Admin immer im Verhinderungsmodus?

Normal sollte ich im Aktivierungsmodus sein. Ich aktiviere den Krempel wenn ich ihn brauche und sonst nicht.

Dann brauche ich mich auch nicht darum kümmern, dass was in der Cloud landet.

Ah, verstehe. Sonst würde ja niemand den ganzen Krempl benutzten was Microsoft soooo toll findet und raushaut.

Und DSGVO ist eh nur für den kleinen Michl, die großen juckt das eh nicht wirklich und drehen sich das dann so wie man es braucht.

Und wenn Microsoft das sagt, dass die Daten nicht für das Training verwendet werden, dann passt das schon so. Gell. Und das soll ich glauben.

Tja Microsoft, bei euch fährt der Aufzug auch nicht mehr ganz nach oben.

Naja MS setzt eeben auf Proaktiven Malwareschutz ;-P Daten die „frei verfügbar“ sind können nicht zur Erpressung genutzt werden und wenn alle Daten sowieso frei verfügbar sind und es keine Geheimnisse mehr gibt, kann die Welt ja nur besser sein ;-P

> Für Copilot-Administratoren könne es überwältigend..

Naja, es dürfte eher der Job eines ISB oder in neudeutsch CISO sein. Administratoren dürften wohl kaum für solche Entscheidungen qualifiziert bzw. ernannt worden sein. Vielleicht in Unternehmen, die noch nichts von einem ISMS gehört haben oder dieses nicht leben.

Erleben wir gerade die Geburt eines neuen Bullshit-Admin Job Title? Nach Sharepoint-Admin oder Teams-Admin nun ein Copilot-Admin?

Sie fallen mir immer wieder mit provokanten Äußerungen hier in den Blog-Kommentaren auf.

Wieso sind denn Sharepoint-Admin, Teams-Admin oder Copilot-Admin wie Sie sagen „Bullshit-Admin“ Job-Titel? Weil das alles Microsoft Produkte sind? Das Sie kein Freund von Microsoft sind ist hinlänglich bekannt.

Ich habe lieber ein Admin der für das eingesetzte Produkt qualifiziert ist und keinen 360° Allrounder der meint die Weisheit mit Löffeln gefressen zu haben und meint alles zu können. Der IT-Bereich ist inzwischen soweit gewachsen, dass man nunmehr nicht für alles zuständig und qualifiziert sein kann.

>Wieso sind denn Sharepoint-Admin, Teams-Admin oder Copilot-Admin wie Sie sagen „Bullshit-Admin“ Job-Titel?

Weil diese sogenannte „Administratoren“ weder systematisches, analytisches noch ingenierwisenschaftliches Denken erforderlich machen. Es sind nichts anderes als Produktbediener eines einzelnen Produktes, von einem Hersteller, das erwiesenermaßen unreifes Zeug in den Markt wirft und keine Verantwortung dafür übernimmt.

Unternehmen, denen das dann in der Regel vorgesetzt wird, haben mit den zusätzlichen Kosten und Risiken zu tun, so wie dieser Artikel das sehr schön beschreibt.

> Der IT-Bereich ist inzwischen soweit gewachsen, dass man nunmehr nicht für alles zuständig und qualifiziert sein kann.

Gish Galopping, hat nichts mit dem Thema zu tun und wurde nicht gesagt. Aber Hauptsache einen rausgelassen oder was?

> Weil diese sogenannte „Administratoren“ weder systematisches, analytisches noch ingenierwisenschaftliches Denken erforderlich machen.

So ein Blödsinn habe ich schon lange nicht mehr gehört. Natürlich denken auch Administratoren, die für ein Produkt zuständig sind systematisch und analytisch. Gerade beim Troubleshooting ist das gefordert und findet meiner Erfahrung nach auch absolut statt.

Das kommt natürlich auch stark auf den Arbeitgeber an. Wenn die Bezahlung unterirdisch ist und die Bedingungen ebenfalls nicht gut sind, dann bekommt man nunmal auch Personal, dass nur das Mindestmaß umsetzt.

> Gish Galopping, hat nichts mit dem Thema zu tun und wurde nicht gesagt.

Ich habe keine Ahnung was Sie mir damit sagen wollen. Selbstverständlich gehört das dazu. Wenn jemand ernsthaft der Meinung ist, dass er in allen Bereichen der IT eine Expertise hat, dann beende ich das Gespräch. Das ist für mich unqualifiziertes und unreflektiertes Geschwätz.

Außerdem: Kommen Sie mal von Ihrem hohen Ross runter. Man kann eine Meinung auch vertreten, ohne provokante Äußerungen.

Schönen Sonntag noch.

+1

Der Herr Jakobs ist schon früher in seiner Tätigkeit als Moderator (weil er ja soooo gut ist in seinem normalen Job, hatte er ja dafür die Zeit) mit provokanten Aussagen aufgefallen.

Man wird ihn auch nicht mehr ändern, er ist der GOAT und macht alles richtig;)

In dem Sinne einen schönen ersten Advent:)

NO_DEV, einigen wir uns doch alle einfach auf „Administrationsrollen“, dann ist es einfacher, sachlich zu bleiben.

Das Ende der Exzellenz-Fahnenstange ist schnell erreicht, wenn man meint, man könne alle MS-Dienste bei etwas größeren Skalierungen an eine Person hängen.

Falls Sie zufällig Unternehmer sind, der Admins für seinen Laden braucht, dann kommen Sie mit „Ich habe lieber ein Admin der für das eingesetzte Produkt qualifiziert ist“ bald nicht mehr weit, es sei denn das Personalbudget gibt es her, den Sharepointspezi, Teamsspezi und Copilotspezi einzustellen.

Danke auch für den „360°“-Lacher, denn mit „365°“ wären Sie vielleicht mißverstanden worden :)

Tja, neben DSGVO wird es für KI im EU-Raum wohl auch solche geben müssen –

https://www.consilium.europa.eu/de/policies/artificial-intelligence/

nur das genau eben so ein Mittelstand, Kleinstunternehmer etc. sich sowas gar nicht leisten kann einen CISO zu bestellen, oder ein ISMS einzuführen – dafür benötigt man zum einen viel Zeit und Know-how und das kostet ordentlich Geld, die zunächst auch mal keine Einnahmen generiert, sondern im „best-case“, zusammen mit dem Navi-CSI ein SIEM/SOC-Team 24/7, das Risiko einer Verschlüsslung und nachträglichen Erpressung verringert.

Der bisherige vermeintliche Hauptschalter gegen den CoPilot wird wohl bald unwirksam gemacht und das ist für einen OnPrem-Betrieb gezielt nachteilig:

https://learn.microsoft.com/en-us/windows/client-management/manage-windows-copilot

Stand: 19.09.2024

Zitat:

„Policy information

Admins should configure the pinning options to enable access to Microsoft Copilot within the Microsoft 365 app in the Microsoft 365 admin center.

The following policy to manage Copilot in Windows (preview) will be removed in the future:

CSP

./User/Vendor/MSFT/Policy/Config/WindowsAI/TurnOffWindowsCopilot“

Group Policy

User Configuration > Administrative Templates > Windows Components > Windows Copilot > Turn off Windows Copilot“

Ersatzweise ist von diesen „Pinning Options“ für die „Navigation Bar“ die Rede, aber das dürfte nur ein Teilbereich des Themas sein:

https://learn.microsoft.com/en-us/copilot/microsoft-365/pin-copilot

Stand: 19.11.2024

(Edit: Da stehen eine Menge Wenns und Danns drin, da muss man mit der Bewertung wohl aufpassen.)

Wer in die Cloud gegangen ist und das Intune Admin Center bedient, darf wohl die Zugriffe diversifizieren:

https://learn.microsoft.com/en-us/mem/intune/apps/manage-microsoft-office#utilize-app-configuration

Stand: 18.09.2024

Zitat:

„Copilot with enterprise data protection

Admins can now enable or disable Copilot in Microsoft 365 app by configuring the following setting in the Intune admin center. To deploy this app setting, use an app configuration policy in Intune.

To manage Copilot in Microsoft 365 app, you can use the following key:

Key: com.microsoft.office.officemobile.BingChatEnterprise.IsAllowed

Value: true (default) Copilot is enabled for the tenant / false disables Copilot for the tenant“

Hat jemand resultierende Registrykeys für „BingChatEnterprise.IsAllowed“ oder so?

Wie macht man ansonsten am besten die Funktionalität mit harten Hacks kaputt?

Bevor ich jetzt mit Kieselsteinen versuche, fließendes Wasser aufzuhalten, lege ich lieber das Flussbett trocken.

Microsoft ist in der Sache leider wie ein Feind zu behandeln. Kann nicht sein, dass man erst alle Daten abschnorcheln lassen soll, damit jemand anderes entscheidet, was schützenswert ist und was nicht.

Diese Intune-Einstellung ist für die iOS- und Android-Apps, daher „officemobile“ im Namen. Das hat nichts mit Registrykeys zu tun.

Oh krass, danke!

Dann habe ich nicht genau genug geguckt.

Hoffentlich kriege ich rechtzeitig mit, wann wo wie die richtigen Einstellungen zu machen sind.

Wenn ich mir so angucke, was für ein Hinterherhinken das in letzter Zeit mit den Edge-Policies war und welcher Vermarktungsdruck im Vergleich hinter Copilot steckt, könnte das noch recht interessant werden…

Was willst du denn überhaupt erreichen? Der „richtige“ Copilot mit MS365-Integration muss ja ohnehin extra lizenziert werden. Wer den nicht kauft, hat ihn auch nicht.

Ansonsten gibt es nur den „Chat mit Unternehmensdatenschutz“. Den abzuschalten wäre wohl eher kontraproduktiv, weil es das Risiko erhöht, dass die User Consumerprodukte mit weniger Datenschutz nutzen.

Leider liegt häufig das was gekauft wurde oder das Detail, wann wer ein Nutzungsrecht erworben hat oder von MS zugestanden bekommen hat, nicht in den Händen derjenigen, die die Aufgabe haben, Datenabflüsse zu regulieren.

Deinen zweiten Teil habe ich nicht verstanden.

Wenn du MS365 *ohne* die kostenpflichtige Copilot-Zusatzlizenz hast, beinhaltet das als Goodie trotzdem den „Chat mit Unternehmensdatenschutz“ unter copilot.cloud.microsoft.

Dieser ist ungefähr das gleiche wie die kostenlose Consumerversion unter copilot.microsoft.com (der ehemalige „Bing Chat“), nur dass deine Eingabedaten nicht zum Training des Modells genutzt werden.

Von daher ist es auf jeden Fall besser, wenn deine User den „Chat mit Unternehmensdatenschutz“ benutzen, als wenn sie zum Bing Chat oder irgendeinem anderen Consumerprodukt greifen, welches die Eingabedaten zu Trainingszwecken absaugt. Ich würde copilot.cloud.microsoft daher nicht abschalten.

Wenn du KI-Nutzung komplett unterbinden willst, musst du das den Mitarbeitern untersagen und vielleicht noch alle möglichen einschlägigen Dienste blockieren.

ianal.

aber ist es nicht so, das wenn mir durch einen Software Fehler Daten zugänglich sind, die ich nicht sehen sollte, mir eh gesetzlich verboten ist darauf zuzugreifen?

ja auch nur darüber zu sprechen, dass es diese Lücke und diese Dokumente gibt?

ich sollte also besser darüber schweigen und nur per Anwalt anonym melden, weil man mir sonst kündigen könnte?

oder gilt das nur für Mitarbeiter von Behörden?

@Alle: In der Original-Quelle steht:

„All of a sudden Joe Blow can see the CEO’s emails.“

Wie soll das bitte technisch funktionieren? Mailboxen unterliegen einem sehr granularen Rechtemodell. Auch wenn der LLM-Lernalgorithmus im Backend alle Rechte auf alle Mailboxen eines M365-Tenants hat, so müssen doch spätestens bei der Copilot-Suchabfrage die Rechte des Abfragers auf die Mailboxen berücksichtigt werden?!

Wenn das LLM aber alle Infos „ausspuckt“, ohne sich um die individuellen Rechte zu kümmern, liegt doch hier ein gravierender Design-Fehler vor!

Oder kann mir jemand den Anwendungsfall aus dem Zitat technisch anders erklären?

Vielen Dank.

Gruß Max

Was hier passiert ist: es wurden Zugriffsrechte zu freizügig gesetzt und das ist zufälligerweise bei der Nutzung von Copilot aufgefallen, weil es eben auch die Daten durchsuchen kann, auf die man ohnehin schon Zugriff hatte.

Es gibt halt zwei Arten mit den Rechte&Rollen einer Box umzugehen.

Einmal kann der Admin was setzen (was nicht so pralle ist) oder der Benutzer selbst hat die Rechte&Rolle individuell vergeben.

Daher interpretiere ich das als ein Benutzerfehler :)

@Damiel: Um in meinem Mailbox-Beispiel zu bleiben:

User Joe Blow HATTE also bereits Rechte auf die Mailbox des CEOs, war sich dessen aber nicht bewusst.

Jetzt indiziert Copilot die Mailbox des CEOs und bringt Inhalte zum Vorschein, auf die Joe Blow schon vorher Rechte hatte.

Da muss ja Copilot sogar noch dankbar sein, dass er diese Misskonfiguration offenlegt ;-)

„Urwumpe“, also wer M365 nutzt bzw. Verantwortlich ist und noch nie was von Graph mitbekommen hat… Keine Ahnung was ich da noch sagen kann. Schwach…

Tunnelblick.

(Denkhinweis: Nicht in jedem Unternehmen ist die IT so aufgestellt, dass sie ihre Arbeit gut machen kann. Und viele Unternehmen nutzen MS365 nur im Abo, ohne dedizierte Fachkraft und ohne Background – ist ja alles einfach, laut Microsoft)

Und nicht jeder hat so qualifiziertes Personal wie dich mit vollem Überblick in seinem Team.

Wer etwas genauer in Office 365 einsteigen möchte, kann sich hier etwas „Weiterbilden“. Ziemlich gute Site

https://jeffreyappel.nl/

und

https://thedxt.ca/

Gibt es irgendwo eine Zusammenfassung aller Domains und IPv4/IPv6-Adressen, die sich in irgendeiner Art und Weise auf Copilot beziehen (können) und den in Windows integrierten Mini-DNS umgehen?

Solche Backdoors braucht wirklich niemand.